La Inteligencia Artificial (IA) se ha convertido en una de las tecnologías más influyentes del siglo XXI. Está presente en teléfonos móviles, ordenadores, automóviles e incluso hospitales. Aunque parezca algo lejano o casi mágico, la IA es un conjunto de técnicas y algoritmos diseñados para que las máquinas aprendan a realizar determinadas tareas que antes requerían capacidad humana. Pero, ¿qué se puede hacer desde las universidades para formar a los futuros ingenieros?

La IA es una rama de la informática que busca desarrollar sistemas capaces de percibir, razonar, aprender y tomar decisiones. No se trata de replicar la mente humana por completo, sino de crear herramientas que puedan resolver problemas específicos.

Uno de los enfoques más importantes dentro de la IA es el Aprendizaje Automático (Machine Learning), que permite que los sistemas mejoren con la experiencia. Los desarrolladores alimentan a los algoritmos con grandes cantidades de datos (Big Data), para que reconozcan patrones y aprendan por sí mismos. Así, un modelo entrenado con miles de imágenes de perros y gatos aprende a distinguirlos, sin que un humano le explique qué características buscar.

Más recientemente, se ha popularizado el Aprendizaje Profundo (Deep Learning), que utiliza redes neuronales. Estas redes permiten resolver problemas complejos, como comprender el lenguaje natural, generar texto o guiar vehículos autónomos. El rendimiento de un modelo depende de la calidad de los datos con los que se entrena. Datos incompletos, sesgados o incorrectos pueden derivar en resultados poco fiables o injustos. Por lo tanto, el desarrollo de la IA no está exento de problemas. Los principales desafíos a los que se enfrenta se pueden agrupar en cinco grandes bloques.

1. Sesgos y decisiones injustas

Los sistemas de IA aprenden de datos generados por humanos, y esos datos contienen prejuicios y errores. Como resultado, los algoritmos pueden reproducir o amplificar desigualdades en ámbitos sensibles, como la selección de personal, la concesión de créditos, la justicia penal o la vigilancia. El reto es construir modelos transparentes, auditables y entrenados con datos representativos.

2. Privacidad y uso masivo de datos

La IA necesita enormes cantidades de información personal.

Esto abre interrogantes sobre quién recopila esos datos, para qué se usan o quién accede a ellos. La recopilación masiva de información amenaza derechos fundamentales si no se introducen regulaciones estrictas y mecanismos de control.

3. Desplazamiento laboral

La automatización impulsada por IA está sustituyendo tareas repetitivas y administrativas en muy diversos sectores. Aunque genera nuevos empleos, la transición no será equilibrada. Las primeras estimaciones indican que la contratación de profesionales informáticos junior en empresas tecnológicas se está resintiendo. Sin embargo, la IA genera nuevos roles: ingenieros de datos, entrenadores de modelos, etc. La clave del futuro laboral no será competir contra las máquinas, sino destacar en su uso y supervisión.

4. Desinformación y manipulación

Las herramientas capaces de generar texto, audio e imágenes realistas han dado lugar a un nuevo fenómeno, los deepfakes y la desinformación. Esto representa un riesgo serio para la confianza pública. La velocidad con la que se pueden producir contenidos falsos supera con creces la capacidad de detectarlos.

5. Seguridad y control de sistemas avanzados

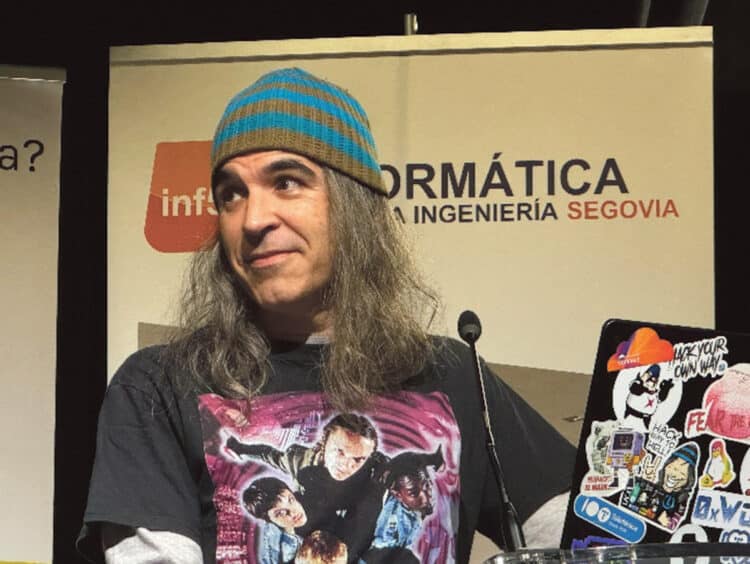

A medida que los modelos evolucionan, aumenta la preocupación por la seguridad y la gobernanza. Es crucial que los sistemas no actúen de forma imprevisible, que tengan límites claros y respondan a valores humanos. La seguridad no ha sido un pilar fundamental en la evolución de la IA hasta el momento, por lo que urge introducir mecanismos de supervisión, alineación y control, aunque la complejidad técnica sea elevada. Grandes profesionales como Chema Alonso, quien ha visitado recientemente el Campus “María Zambrano” de la UVa, repiten el mensaje de forma reiterada: “Vivimos en una época en la que la Inteligencia Artificial nos genera a la vez un asombro increíble y un miedo que, a veces, paraliza”.

El papel fundamental de los profesores de Facultades y Escuelas de Ingeniería

Ante este panorama, los docentes que forman a los próximos ingenieros tienen una responsabilidad histórica. No basta con enseñar a programar redes neuronales o manejar modelos generativos: es necesario un enfoque integral que incluya ética, seguridad y pensamiento crítico.

Los estudiantes deben comprender no solo los mecanismos internos de los modelos, sino también sus límites: cómo se producen los sesgos, qué es el sobreajuste, cómo detectar errores, etc. Conocer el fallo es tan importante como dominar la técnica.

Los futuros ingenieros deberán ser capaces de evaluar impactos sociales, respetar la privacidad de los datos, auditar sistemas y diseñar algoritmos explicables. La ética de la IA no puede ser un curso optativo: debe integrarse transversalmente en toda la formación.

Es esencial enseñar a dudar. Los estudiantes deben aprender a interpretar y cuestionar resultados automáticos, contrastarlos con evidencias y detectar anomalías. La ingeniería no es obediencia a la herramienta: es control y supervisión.

La Inteligencia Artificial seguirá avanzando, pero su dirección dependerá de quiénes la construyan. Las Escuelas y Facultades de ingeniería no solo preparan a profesionales: forman a los futuros diseñadores del mundo digital. En un momento en que la tecnología puede multiplicar tanto el progreso como los riesgos, la educación es, más que nunca, la primera línea de defensa.

——

(*) Profesores y equipo directivo de la Escuela de Ingeniería Informática de Segovia UVa.